AIの正答率とAIによるBias(先入観)

ネットフリックスの番組で、AIによるBias(先入観、偏見)について取り上げていて、

AIのBiasとは何かと思い、見入ってしまいました。番組は、基本的に顔認証について取り上げ

ていました。

AIの顔認証技術において、正確性の問題やバイアスの存在が報告されていることは事実のよう

です。AIの顔認識システムは、ディープラーニングや機械学習のアルゴリズムを使用して、顔

画像を解析し、特定の人物を識別することを試みます。

しかし、AIの顔認識技術は、訓練データセットの選択やそのデータのバイアス、アルゴリズム

の設計など、さまざまな要素によって影響を受けます。これにより、一部のグループや属性に

対して誤った判断を下す可能性があります。たとえば、肌の色、性別、年齢など、識別の正確

性に影響を与えることがあるのです。顔認識システムが訓練されたデータセットが、主に特定

の人種や性別の人々に偏っている場合、正確性が低下する可能性があります。

番組で取り上げていた事例では、犯罪者のデータを集めると残念ながら、黒人のデータが多く

なる傾向があります。そのために、一般の黒人男性を顔認証システムが捉えると白人よりも犯

罪発生率の高い人として、区別してしまう傾向があるということも伝えていました。

まさにBiasですね。

このようなバイアスは、訓練データにおける偏りや、適切でないデータセットの使用、アルゴ

リズムの設計上の欠陥などから生じることがあります。また、特定の人種や民族、性別などに

対して特に問題がある場合、差別や不公平な扱いのリスクが生じる可能性もあります。

ただ、人間が、AIが完璧なものであるという「偶像」を作り上げてしまうことが一番の問題で、

失敗を失敗として受け入れて次により良い活用していくことも大事であると思います。

当社のAIガードマンでは、万引き行為をする人を発見するときに、どうしても従業員を誤検知

してしまうということから、AIの画像認識を活用して、従業員を省くように学習させています。

小売業の現場では、従業員は商品の品出しやお客様に商品などを案内するにあたり、うろうろ、

キョロキョロして、商品を選ぶ一般のお客様とは違う動きをしています。そのため、AIガード

マンは、従業員を「普通の買い物客とは違う」と判断して、万引き犯として、誤検知してしま

う場合があります。お客様ではない動きを発見するのは技術的には合っているのだと思うので

すが、運用的には活用できません。

この誤検知の改善方法として、当社は、従業員の制服をAIガードマンに数千枚学習させること

で、従業員の誤検知を最小限に抑えることに成功しています。

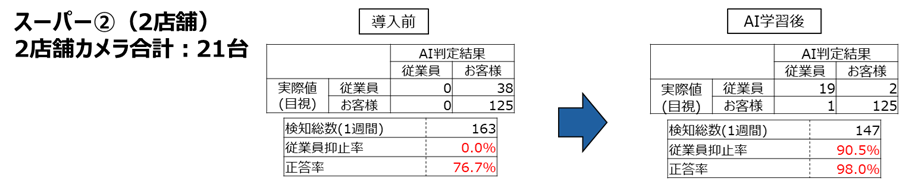

下記は、従業員の制服を3ヵ月間、トータル4000枚の学習をさせた結果です。学習が足りてい

ない最初の導入時の環境では、従業員をお客様(万引き犯と思われる行動)として月に38件も

間違えていたのが、学習後は2件だけです。お客様(万引き犯とも思われる行動をした人)を

逆に従業員と間違えるのは、1/126件 全体の正答率98%となりました。

ビックデータと言われますが、確かにビックデータがあればあるほど、AIの学習には役立て

られます。しかしながら、運用者は、絞り込んだ環境でAIを活用する場合もあります。

AIのはじき出すデータをどのように考えるかは、人間の知識も必要なのです。